Mit immer mehr Tools auf dem Markt, die Ärzten bei Tests, Diagnosen oder der Entwicklung von Behandlungsplänen helfen, zweifelt niemand mehr daran, dass künstliche Intelligenz eine echte Revolution im Gesundheitswesen darstellt.

Bis 2030 wird der Markt für medizinische künstliche Intelligenz voraussichtlich 188 Milliarden Dollar wert sein.

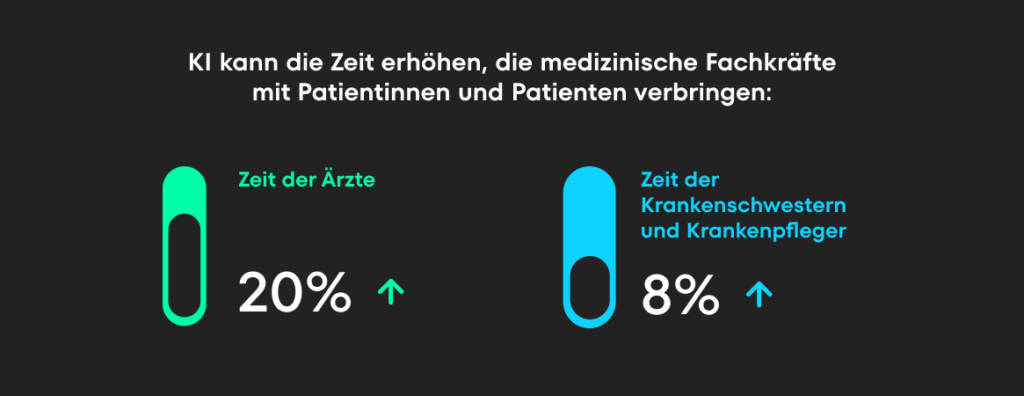

Experten zufolge wird die Implementierung künstlicher Intelligenz im Gesundheitswesen es Ärzten ermöglichen, ihre Zeit mit Patienten um nahezu 20% zu erhöhen, da der Zeitaufwand für administrative Aufgaben reduziert wird. Ebenso wird erwartet, dass Krankenschwestern rund 8% mehr Zeit mit Patienten verbringen können, da ihre administrative und regulatorische Arbeitsbelastung ebenfalls verringert wird.

Der Hype ist real, ebenso wie die Missverständnisse. Manche Leute denken, KI wird zum Superhelden des Gesundheitswesens und löst jedes Problem. Andere befürchten, dass sie Ärzte vollständig ersetzen wird.

Nicht ganz! Künstliche Intelligenz hat ihre Grenzen, und wir müssen uns dessen bewusst sein. Deshalb sind wir hier, um das Rauschen zu durchdringen.

Indem wir verstehen, wie diese Tools arbeiten und was sie heute leisten, können wir klügere und effektivere Lösungen für morgen entwickeln. Dieser Artikel beleuchtet reale Beispiele, wie große Sprachmodelle (LLMs) bereits medizinischen Fachkräften helfen.

Was ist das Large Language Model?

Zunächst einmal erklären wir, was ein LLM ist. Ein Large Language Model ist eine Art von KI-Algorithmus, der tiefe Lerntechniken und große Datensätze verwendet, um menschliche Ausgaben zu verstehen und zu produzieren. Sie können das nächste Wort in einer Sequenz basierend auf den vorherigen Wörtern vorhersagen. LLMs können Fragen beantworten, Aufsätze schreiben, Texte zusammenfassen, Sprachen übersetzen und sogar Code schreiben.

Ihre Fähigkeiten machen sie in verschiedenen Bereichen des Gesundheitswesens anwendbar, von denen wir vier hervorgehoben und repräsentative Fallstudien für jeden ausgewählt haben. Diese Bereiche sind:

LLMs in der Gesundheitsverwaltung

Der erste Bereich im Gesundheitswesen, in dem KI einen bedeutenden Unterschied machen wird, ist die Verwalatung.

Im Jahr 2018 führte die American Medical Association eine Studie durch, die detailliert untersuchte, wie viel Zeit Ärzte mit administrativen Aufgaben und Papierkram verbringen. Die Autoren des Berichts sammelten Daten von mehr als 20.000 Ärzten aus fast 30 Fachgebieten, und die Ergebnisse waren nichts weniger als „verblüffend“ und zeigten, dass:

- Fast ein Drittel der Ärzte verbringt über 20 Stunden pro Woche mit administrativen Aufgaben.

- Trotz dieser zusätzlichen Arbeitsbelastung bleibt die Zeit für die Patienten unverändert. Die längeren Arbeitsstunden kommen nicht den Patienten zugute, sondern gehen für Papierkram drauf.

Mind Matters (Surrey and Borders Partnership NHS Foundation Trust) stand vor einem ähnlichen Problem. Ein Anstieg der Überweisungen und Rekrutierungsschwierigkeiten führte zu einer erheblichen administrativen Belastung bei Mind Matters. Dies führte zu Ineffizienzen im Überweisungsprozess und beeinträchtigte das Wohlbefinden der Mitarbeiter negativ.

Als Reaktion auf diese Herausforderungen entschied sich das Mind Matters-Team, einen KI-Chatbot einzuführen.

Das Ziel war den Überweisungsprozess zu vereinfachen, administrative Verwirrung zu reduzieren, die Effizienz des Teams zu steigern und das Wohlbefinden der Mitarbeiter zu verbessern.

Der Chatbot “Limbic” war auf der Website verfügbar. Er war der erste Kontakt der Patientin oder des Patienten mit der Einrichtung. Er führte natürliche Gespräche und führte sie durch den Überweisungsprozess. Dies ersetzte lange und umständliche Anmeldeformulare und machte den gesamten Prozess flexibler (zum Beispiel stellte der Bot Nichtrauchern keine Fragen zum Rauchen). Basierend auf den Antworten gab es auch Möglichkeit der Weiterleitung zu geeigneteren Diensten.

Das System wendete entsprechende Benachrichtigung an, wenn der Zustand der Patientin oder des Patienten Priorität erforderte.

Ergebnisse?

- Begeisterung der Patientinnen und Patienten: nahezu alle berichteten, dass Limbic hilfreich war (98,72%)

- 30% Anstieg bei der Überweisungsbearbeitung

- Gesparte Zeit pro Überweisung für medizinische Mitarbeiter: Durchschnittlich15 Minuten, was sich in 2.000 Stunden (zum Zeitpunkt der Erstellung der Fallstudie) übersetzte.

- Nahezu 20% der Überweisungen wurden als nicht geeignet identifiziert und an einen geeigneteren Dienst weitergeleitet, was zusätzliche Kapazitäten für den Dienst schuf.

Limbic war mit NHS Spine verbunden (der nationalen IT-Infrastruktur, die Gesundheits- und Sozialdienste in England unterstützt), sodass die Eignung der Überweisungen unabhängig überprüfen sein konnte.

Im Laufe der Zeit haben sich die Einsatzmöglichkeiten von Limbic erweitert, einschließlich der Nutzung im Bereich der psychischen Gesundheitstriage. Limbic wurde zum beliebtesten Chatbot für psychische Gesundheitstriage innerhalb des NHS und wird nun in 17 Regionen im Vereinigten Königreich eingesetzt.

Derzeit für über 9 Millionen Menschen zugänglich, hat Limbic die Bereitstellung von mehr als 20.000 klinischen Stunden für psychologische Therapiedienste ermöglicht.

Bildung

Das Feld der Medizin ist untrennbar mit der Ausbildung verbunden. Hier treten LLMs als transformative Tools hervor, weil sie das Potenzial haben, das Lernerlebnis erheblich zu verbessern.

Um Missverständnisse zu vermeiden – LLMs sind nicht dazu gedacht, Abkürzungen in der medizinischen Ausbildung zu schaffen

Stattdessen eröffnen sie Möglichkeiten für effektivere Lernmethoden, die über das traditionelle Auswendiglernen hinausgehen. Stellen Sie sich einen Wandel vom rein lehrbuchbasierten Lernen hin zu einem dynamischen, interaktiven Ansatz vor, der ein tieferes Verständnis fördert.

Relevanz für den medizinischen Sektor

Dieser Fokus auf verbessertes Lernen ist besonders relevant angesichts des dringenden Problems des Arbeitskräftemangels im Gesundheitswesen. Ein beitragender Faktor ist die anspruchsvolle Natur der aktuellen medizinischen Ausbildung. LLMs, mit ihrer Fähigkeit, kreativ mit großen Informationsmengen umzugehen, haben das Potenzial, medizinisches Wissen zu demokratisieren und es zugänglicher und effizienter zu machen – und das nicht nur für Studierende.

Die medizinische Ausbildung ist ein nie endender Prozess – schließlich müssen praktizierende Ärzte über die neuesten Forschungen auf dem Laufenden bleiben, um die Patientenversorgung zu verbessern.

Google MedPaLM und USMLE

Bedenken Sie die Fortschritte von Google.

Im Dezember 2022 erreichte ihr Med-PaLM-Modell, das auf einem umfassenden Datensatz medizinischer Informationen trainiert wurde, Erfolge bei einer Prüfung, die das USMLE (eine wichtige Lizenzprüfung für Ärzte in den Vereinigten Staaten) simulierte. Das Modell erzielte beeindruckende 67,5%, was die Bestehensgrenze überschritt.

Bemerkenswerterweise erzielte die nächste Generation, Med-PaLM 2, nur wenige Monate später im Juli 2023 eine noch höhere Punktzahl von 86,5% bei derselben Prüfung!

Wie können LLMs die medizinische Ausbildung unterstützen?

Es wurde dann erkannt, dass richtig vorbereitete Chatbots eine wichtige Rolle im medizinischen Bildungsprozess spielen könnten. Ihre Fähigkeit, große Informationsmengen zu verarbeiten, nicht nur Text, sondern auch Bilder, Diagramme und Infografiken, macht sie zu einem leistungsstarken Tool, um Studenten bei ihrem Studium zu unterstützen.

Spezifische Möglichkeiten zur Unterstützung der medizinischen Ausbildung sind zahlreich. Einer der vielversprechendsten Wege ist die Nutzung von Chatbots als personalisierte Lernassistenten, die bestimmte komplexe Themen auf einfachere, verständlichere Weise erklären. Hier ist ein Beispiel für ein solches Gespräch:

Mensch: Erkläre einem fünfjährigen Kind, wie das menschliche Kreislaufsystem funktioniert?

GPT-4: Sicher, stellen wir uns den menschlichen Körper als eine große Stadt vor. Das Kreislaufsystem ist wie der Lieferservice der Stadt.

Herz: Das ist wie das Lieferzentrum. Es ist ein starker Muskel, der das Blut pumpt. Es arbeitet die ganze Zeit ohne Pausen.

Blut: Das ist wie die Lieferwagen. Sie transportieren Sauerstoff und Nährstoffe (das Essen und die Luft, die die Zellen brauchen) zu allen Teilen des Körpers. Sie nehmen auch Abfälle, wie Kohlendioxid, mit, um sie zu entfernen.

Blutgefäße: Das sind die Straßen für die Lieferwagen. Es gibt große Autobahnen (Arterien), kleinere Straßen (Kapillaren) und Rückwege (Venen). Die Arterien transportieren Blut vom Herzen zum Körper, die Kapillaren verbinden Arterien mit Venen in Geweben und Organen, und die Venen transportieren das Blut zurück zum Herzen. Das Herz sendet die Blutwagen auf den Gefäßstraßen aus, um Sauerstoff und Nährstoffe zu liefern und Abfallstoffe aufzunehmen. Dann kehren sie zum Herzen zurück, um sich auf die nächste Fahrt vorzubereiten. Dies geschieht immer wieder, Tag und Nacht, um unsere Körperstadt reibungslos am Laufen zu halten!

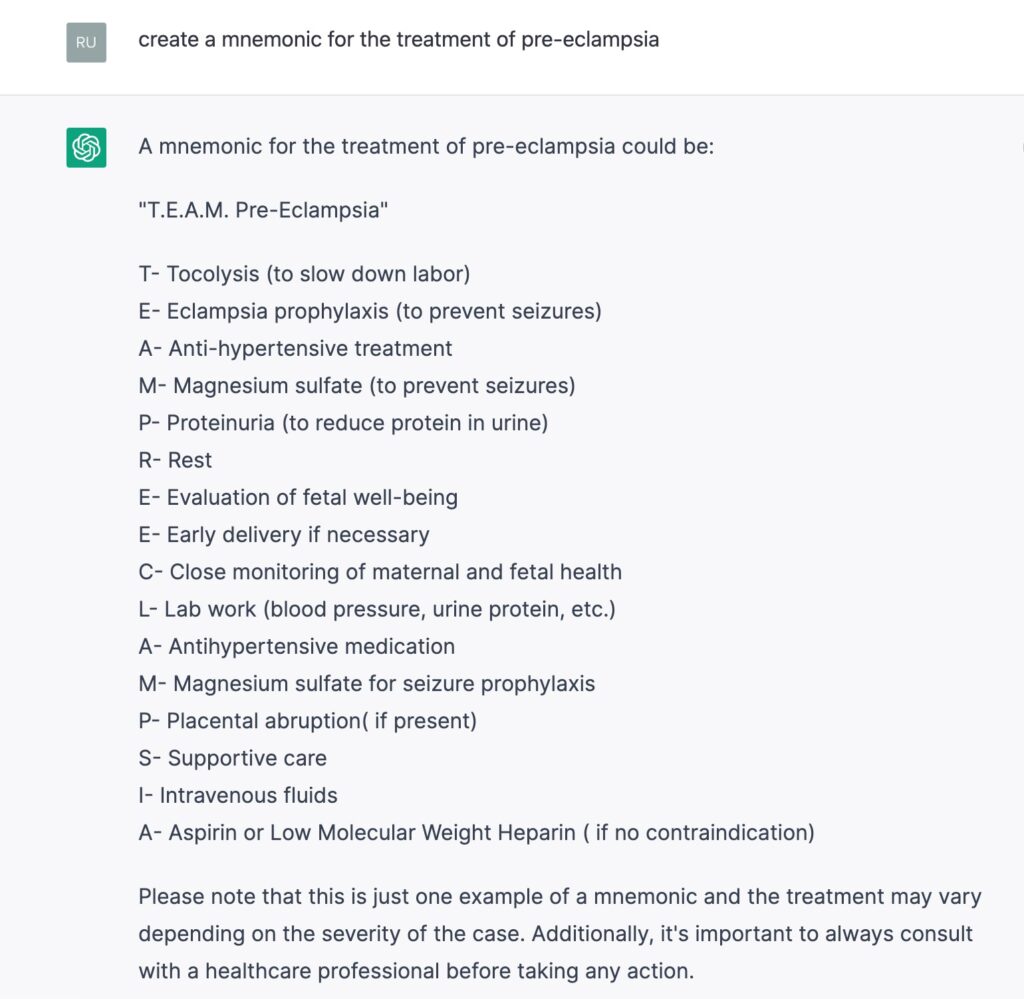

Ein solcher Assistent kann auch kreativ helfen, so dass bestimmtest Material leichter zu merken ist. Hier ist ein Beispiel für die Nutzung von GPT zur Erstellung einer Eselsbrücke:

Prompt: „Erstellen Sie eine Eselsbrücke für die Behandlung von Präeklampsie.“

Welche Einschränkungen gibt es bei LLMs in der medizinischen Ausbildung?

Während große Sprachmodelle (LLMs) enormes Potenzial für die Toolgestaltung bieten, ist es wichtig, ihre Grenzen zu erkennen. In den obigen Beispielen wurden frei verfügbare Tools wie GPT-3.5 verwendet. Dies hat zwei Hauptnachteile:

- veraltete Informationen.

- Tendenz zur Generierung ungenauer oder irreführender Inhalte (Halluzinationen).

Während kostenpflichtige Lösungen diese Probleme mindern können, können sie sie nicht vollständig beseitigen. Daher ist ein klares Verständnis dieser Grenzen entscheidend bei der Gestaltung von Tools oder der Erstellung von Prompts.

Unten ist ein Beispiel für die potenziellen Fallstricke von LLMs in der Ausbildung. Während die Fehler in der Antwort des LLMs offensichtlich erscheinen mögen, ist dies nicht immer der Fall. Studenten, denen die Fähigkeiten fehlen, die von diesen Tools präsentierten Informationen effektiv zu überprüfen, sind anfälliger dafür, in die Irre geführt zu werden.

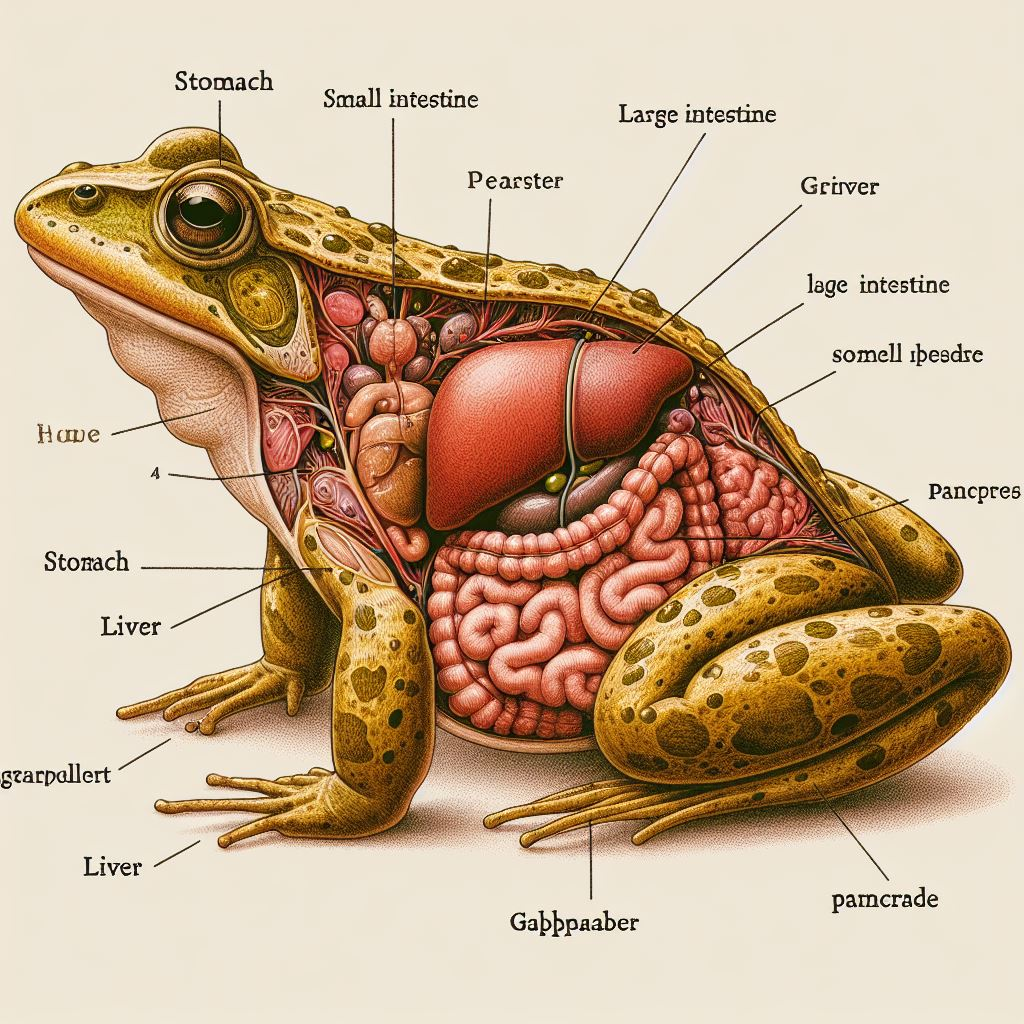

Prompt: „Erstellen Sie eine Infografik, die zeigt, wie das Verdauungssystem des Frosches funktioniert.“

Wie verbessern LLMs die medizinischen Forschungsprozesse?

Ein weiterer Bereich der modernen Medizin, in dem LLMs bereits verwendet werden, ist die Forschung. Und ebenso wie im Fall der Ausbildung gibt es zahlreiche parallele Anwendungsfälle für AI Tools im Forschungsprozess.

- Datenanalyse: LLMs können bei der Analyse komplexer medizinischer Daten helfen, Muster identifizieren und Erkenntnisse generieren, die die Forschung leiten können.

- Literaturzusammenfassung: LLMs können sich durch massive Mengen an medizinischen Forschungspapieren und klinischen Daten wühlen, um Trends zu identifizieren, Informationen zu synthetisieren und prägnante Zusammenfassungen komplexer Themen zu erstellen.

- Hypothesengenerierung: LLMs können bestehende Forschung und Patientendaten analysieren, um potenzielle Verbindungen zu identifizieren und neue Hypothesen für weitere Untersuchungen vorzuschlagen.

- Arzneimittelentdeckung und -entwicklung: LLMs können verwendet werden, um große Datensätze von Molekülstrukturen und biologischen Wegen zu analysieren, um potenzielle Arzneimittelziele zu identifizieren und die Entwicklung neuer Behandlungen zu beschleunigen.

- Papier schreiben: LLMs können beim Verfassen von Forschungspapieren helfen, um sicherzustellen, dass sie gut strukturiert sind und den relevanten Stilrichtlinien entsprechen.

LLMs im Arzneimittelentdeckungsprozess

Die Entdeckung neuer Medikamente ist ein komplexer, zeitaufwändiger und kostspieliger Prozess. Es dauert oft Jahre sorgfältiger Forschung, rigoroser Tests und erheblicher finanzieller Investitionen.

Der traditionelle Prozess der Arzneimittelentdeckung kann bis zu 15 Jahre dauern und mehr als 2,6 Milliarden Dollar kosten, laut einer Studie des Tufts Center for the Study of Drug Development.

In diesem Zusammenhang haben sich LLMs als transformative Tools im Bereich der medizinischen Forschung, insbesondere in der Arzneimittelentdeckung, etabliert. Ihre Fähigkeiten ermöglichen es ihnen, riesige Mengen biomedizinischer Literatur, Patente und klinischer Studiendaten in einem Bruchteil der Zeit zu analysieren, die ein menschlicher Forscher benötigen würde. Dies kann die Anfangsphasen der Arzneimittelentdeckung erheblich beschleunigen, die die Identifizierung potenzieller Arzneimittelziele und Kandidatenmoleküle umfassen.

BenevolentAI Fallstudie

Ein positives Beispiel für die Nutzung solcher Technologien ist BenevolentAI, ein Unternehmen mit Sitz im Vereinigten Königreich. Sie nutzten ein von ihnen entwickeltes LLM, um eine potenzielle Behandlung für COVID-19 zu identifizieren. Die KI-basierte Hypothese des Unternehmens war, dass „Baricitinib“, ein Medikament, das zur Behandlung von rheumatoider Arthritis und anderen Krankheiten zugelassen ist, bei der Behandlung von COVID-19 wirksam sein könnte.

Diese Hypothese wurde durch eine groß randomisierte klinische Studie validiert, die vom National Institute of Allergy and Infectious Diseases (NIAID) gesponsert wurde. Die Studie umfasste mehr als 1.000 Patientinnen und Patienten und begann am 8. Mai, um die Wirksamkeit und Sicherheit von „Baricitinib“ plus Remdesivir im Vergleich zu Remdesivir bei Hospitalisierten mit COVID-19 zu bewerten.

Die Ergebnisse zeigten, dass „Baricitinib“ in Kombination mit Remdesivir eine statistisch signifikante Reduktion der Erholungszeit der Patientinnen und Patienten im Vergleich zu Remdesivir allein.

Darüber hinaus zeigten Daten aus der COV-BARRIER-Studie von Eli Lilly, dass „Baricitinib“ die Sterblichkeit bei COVID-19- Hospitalisierten um 38% reduzierte. Dies ist der größte bisher berichtete klinische Effekt zur Reduzierung der Sterblichkeit in dieser Patientengruppe.

Zusammengefasst hat die Implementierung dieser Lösung vielversprechende Ergebnisse erbracht. Der Einsatz von KI durch BenevolentAI in der Forschung zur Behandlung von COVID-19 führte zur Identifizierung einer potenziellen Behandlung, die durch klinische Studien validiert wurde und vielversprechende Ergebnisse bei der Reduzierung der Erholungszeit und der Sterblichkeit bei COVID-19- Hospitalisierten zeigte. LLMs können neue biologische Ziele vorschlagen.

Wenn diese validiert, als sicher eingestuft und als vielversprechend angesehen werden, könnten sie zu einem Programm für die Arzneimittelentwicklung führen.

Wie helfen LLMs bei der Diagnose?

Viele Menschen könnten denken, dass der Einsatz von KI in der Medizin hauptsächlich darin besteht, Krankheiten zu diagnostizieren. Man kann sich leicht ein Szenario vorstellen, in dem ein Chatbot einer Patientin oder einem Patienten ein paar Fragen stellt, ihre Antworten zusammen mit anderen Informationen wie Behandlungshistorie analysiert und dann – poof! – die KI liefert eine Diagnose und einen Behandlungsplan.

Aber die Realität ist viel nuancierter. Die Diagnose ist ein komplexes Puzzle, das das Wissen des Arztes, eine tiefgehende Datenanalyse und sogar starke zwischenmenschliche Fähigkeiten erfordert, um die Erfahrung der Patientin oder des Patienten zu verstehen.

Es ist äußerst schwierig, wenn nicht unmöglich, diesen Prozess vollständig mit einem Tool nachzubilden.

Es ist zwar einfacher, jedoch immer noch eine Herausforderung, ein KI-Tool zu entwickeln, das die Arbeit von Menschen unterstützt und ihnen dadurch Zeit und Energie spart. Basierend auf realen Beispielen können LLMs:

- die Effizienz des klinischen Arbeitsablaufs verbessern,

- Diagnosefehler reduzieren,

- medizinische Fachkräfte dabei unterstützen, rechtzeitige und genaue Diagnosen zu stellen.

Können LLMs bei der Differenzialdiagnose helfen?

Die Studie wurde erneut von Google durchgeführt. Sie nutzten ein Modell mit einer transformierenden Architektur – PaLM 2, das mit Daten aus dem medizinischen Bereich feinabgestimmt wurde.

Das Ziel war es, ein LLM für diagnostisches Denken zu optimieren und seine Fähigkeit zu bewerten, eine Differenzialdiagnose eigenständig oder als Unterstützung für Ärzte zu erstellen.

Die Studie umfasste 20 Ärzte, die 302 herausfordernde, reale medizinische Fälle aus den Fallberichten des New England Journal of Medicine (NEJM) bewerteten. Jeder Fallbericht wurde von zwei Ärzten gelesen, die zufällig einer von zwei Unterstützungsbedingungen zugeordnet wurden:

- von Suchmaschinen und Standardmedizinischen Ressourcen, oder

- LLM-Unterstützung zusätzlich zu diesen Tools.

Alle Ärzte führten zunächst eine ungestützte Differenzialdiagnose durch, bevor sie die Hilfsmittel nutzten.

Die Ergebnisse waren vielversprechend.

Das LLM-Tool war sehr gut darin, mögliche Diagnosen (Differenzialdiagnosen) vorzuschlagen. Tatsächlich schnitt es alleine besser ab als Ärzte!

- Fast 60% Genauigkeit bei den Top-10-Diagnosen (vs. nur 33% für Ärzte)

- Ärzte, die das LLM zur Unterstützung nutzten, stellten auch bessere Diagnosen als Ärzte, die es nicht nutzten.

Zusammenfassend deutet diese Studie darauf hin, dass LLMs vielversprechend sind, um das diagnostische Denken und die Genauigkeit von Ärztinnen und Ärzten, insbesondere bei komplexen Fällen, zu verbessern.

Eine weitere Evaluierung in der realen Welt wäre aber notwendig.

Zusammenfassung

Die KI-gestützte Technologierevolution beginnt gerade und breitet sich über verschiedene Branchen aus. Das Gesundheitswesen stellt jedoch eine besondere Herausforderung dar. Die hohen Risiken führen zu einem Netz aus Vorschriften und einer natürlichen Vorsicht bei der Einführung neuer Ideen.

Dies bedeutet, dass einige vielversprechende Lösungen in der Testphase stecken bleiben und ihre Auswirkungen in der realen Welt verzögern.

Trotz dieses Hindernisses bieten diese Fortschritte einen Einblick in die Zukunft des Gesundheitswesens und zeigen, wohin sich der Markt entwickelt. Unternehmen, die diese Lösungen durchdacht und zügig implementieren, werden sich als die großen Gewinner etablieren.

Wer sind wir?

Bei NubiSoft sind wir auf die Zusammenarbeit mit dem Gesundheitssektor spezialisiert und bieten maßgeschneiderte Lösungen unter Einsatz von KI an.

Wir glauben, dass gut, auf die Leistungserbringer, Krankenkassen, Arztpraxen usw., zugeschnittene Lösungen einen echten Unterschied in der Arbeit von medizinischen Fachkräften machen können.

Wir sind bereit, Ihrem Unternehmen zu helfen, sicher und nachhaltig an der KI-Revolution teilzunehmen. Kontaktieren Sie uns, wenn Sie ebenfalls bereit dafür sind.

Quellen:

- https://www.statista.com/statistics/1334826/ai-in-healthcare-market-size-worldwide/

- https://radixweb.com/blog/ai-in-healthcare-statistics

- https://www.ama-assn.org/practice-management/sustainability/do-you-spend-more-time-administrative-tasks-your-peers

- https://www.statnews.com/2023/02/01/promises-pitfalls-chatgpt-assisted-medicine/

- https://limbic.ai/nhs-talking-therapies

- https://transform.england.nhs.uk/key-tools-and-info/digital-playbooks/workforce-digital-playbook/using-an-ai-chatbot-to-streamline-mental-health-referrals/

- https://sites.research.google/med-palm/

- https://mededu.jmir.org/2023/1/e46885

- https://www.ncbi.nlm.nih.gov/pmc/articles/PMC10463084/

- https://lifesciences.n-side.com/blog/what-is-the-average-time-to-bring-a-drug-to-market-in-2022

- https://www.techuk.org/resource/aiweek2023-benevolentai-mon.html

- https://www.prnewswire.com/news-releases/benevolentai-data-from-eli-lillys-cov-barrier-trial-shows-baricitinib-reduced-deaths-in-hospitalised-covid-19-patients-by-38-301265356.html

- https://www.mobihealthnews.com/news/study-google-reveals-llm-helps-accurately-diagnosis-complex-cases